MITRE lanza matriz de amenazas para Machine Learning

Microsoft y MITRE, en colaboración con una docena de otras organizaciones,

han desarrollado un marco

diseñado para ayudar a identificar, responder y remediar ataques dirigidos a

sistemas de aprendizaje automático y Machine Learning (ML).

De hecho, una encuesta reciente realizada por el gigante tecnológico entre 28organizaciones reveló [PDF] que la mayoría de ellas (25) no tienen las herramientas necesarias para proteger los sistemas de aprendizaje automático y buscan explícitamente orientación.

"Descubrimos que la preparación no se limita solo a organizaciones más pequeñas. Hablamos con compañías Fortune 500, gobiernos, organizaciones sin fines de lucro y organizaciones pequeñas y medianas", dice Microsoft.

The Adversarial ML Threat Matrix, que Microsoft ha lanzado en colaboración con MITRE, IBM, NVIDIA, Airbus, Bosch, Deep Instinct, Two Six Labs, Cardiff University, University of Toronto, PricewaterhouseCoopers, Software Engineering Institute en Carnegie Mellon University, y el Berryville Institute of Machine Learning, es un marco abierto centrado en la industria que tiene como objetivo abordar este problema.

Según un informe de Gartner citado por Microsoft, se espera que el 30% de todos los ciberataques de IA para 2022 aprovechen el envenenamiento de datos de entrenamiento, el robo de modelos o las muestras adversas para atacar los sistemas impulsados por el aprendizaje automático.

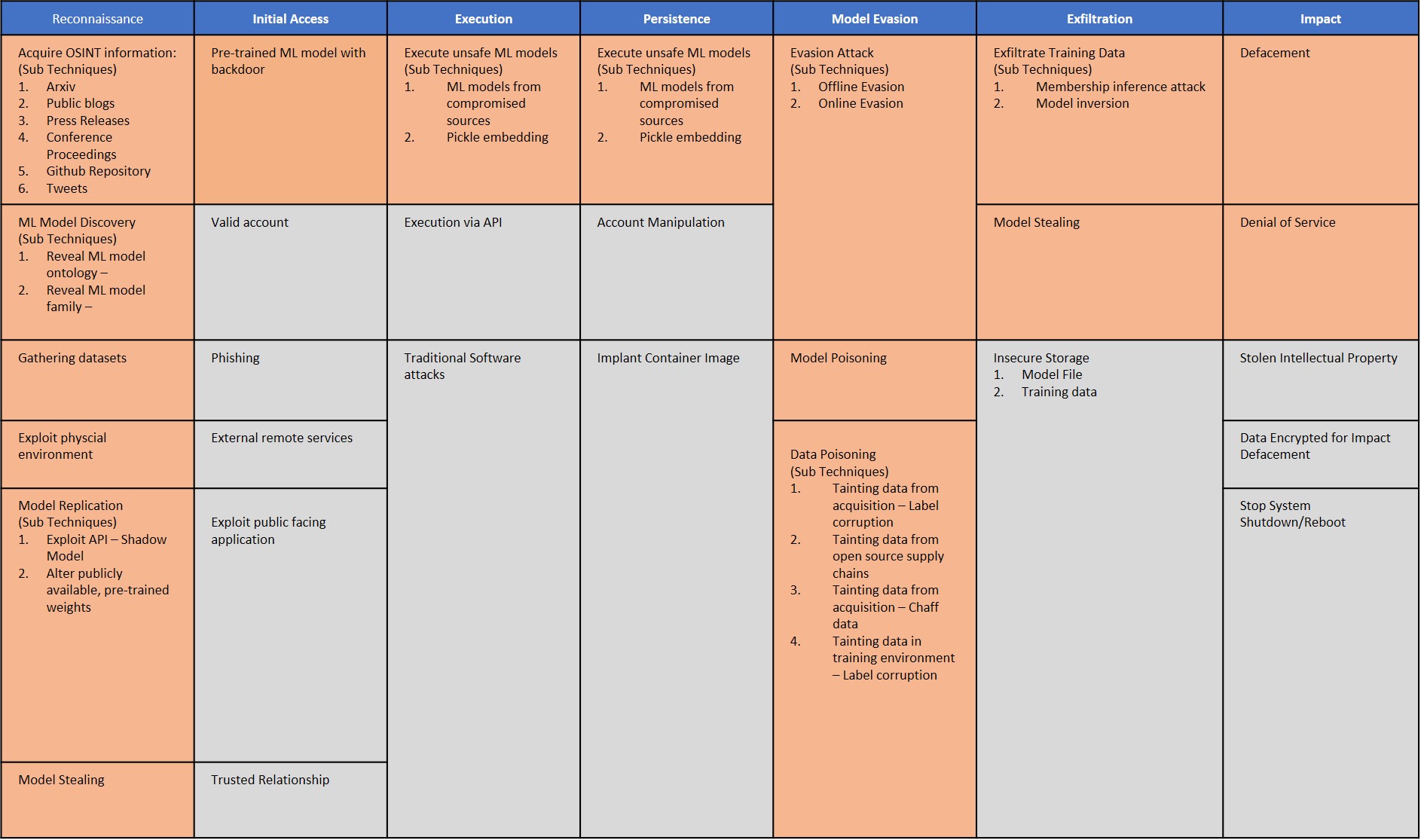

El

marco proporciona información sobre las técnicas empleadas por los adversarios

cuando se dirigen a los sistemas de machine learning y está dirigido

principalmente a los analistas de seguridad. Estructurada como el marco de

ATT&CK, la Matriz de amenazas de ML Adversarial se basa en ataques

observados que han sido examinados como efectivos contra los sistemas de ML de

producción.

Los ataques dirigidos a estos sistemas son posibles

debido a las limitaciones inherentes que subyacen a los algoritmos de ML y

requieren un nuevo enfoque de seguridad y un cambio en la forma en que se

modela el comportamiento del adversario cibernético, para garantizar el

reflejo preciso de los vectores de amenazas emergentes, así como el

aprendizaje automático adversario en rápida evolución. ciclo de vida del

ataque.

"MITRE tiene una amplia experiencia con problemas de múltiples partes

interesadas y técnicamente complejos. […] Para tener éxito, sabemos que

debemos aportar la experiencia de una comunidad de analistas que comparten

datos de amenazas reales y mejoran las defensas. Y para que eso funcione,

todas las organizaciones y analistas involucrados deben estar seguros de que

cuentan con una parte neutral y confiable que pueda agregar estos incidentes

del mundo real y mantener un nivel de privacidad, y lo tienen en MITRE",

dijo Charles Clancy, senior vicepresidente y gerente general de MITRE Labs.

El marco

recién lanzado es un primer intento de crear una base de conocimiento sobre la

forma en que los sistemas de aprendizaje automático pueden ser atacados y las

empresas asociadas lo modificarán con la información recibida de la comunidad

de seguridad y aprendizaje automático. Por lo tanto, se alienta a la industria

a ayudar a llenar los vacíos y a participar en los

debates de este Grupo de Google.

Este esfuerzo está dirigido a los analistas de seguridad y la comunidad de seguridad en general: la matriz y los estudios de caso están destinados a ayudar en la elaboración de estrategias de protección y detección; el framework siembra ataques en los sistemas ML, para que puedan realizar con cuidado ejercicios similares en sus organizaciones y validar las estrategias de monitoreo.

Fuente: SecurityWeek

0 Comments:

Publicar un comentario

Gracias por dejar un comentario en Segu-Info.

Gracias por comentar!